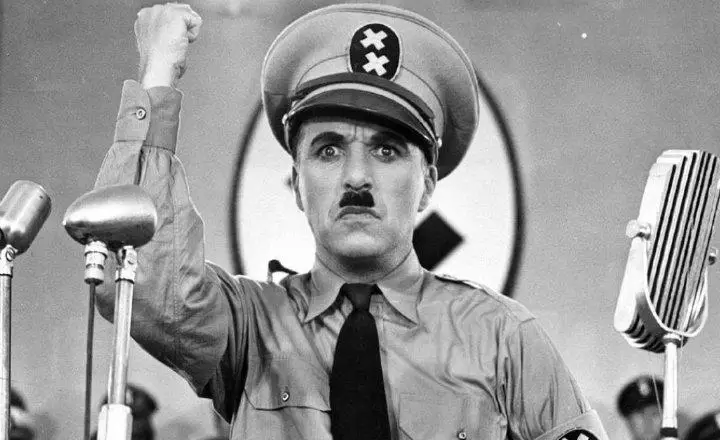

La autoridad, por sí sola, no afecta la integridad física y psicológica de una persona, pues, se debería aplicar con sabiduría, sin abuso de poder. Sin embargo, el autoritarismo propone un régimen cruel, privando de ciertos beneficios a quien esté bajo el. A nivel histórico, se ha empleado este término, en conjunto con totalitarismo, para hablar de importantes gobiernos que se consolidaron, como el nazismo, el fascismo, el franquismo y estalinismo, los cuales hicieron uso de su soberanía para exterminar a cualquiera con ideas distintas a las suyas, con la esperanza de que esto provocará una homogeneidad política en todo el territorio.

Es usual que en los partidos que se guíen por el autoritarismo se halle un alto índice de corrupción, ligado a asuntos económicos, políticos y sociales. Algunos autores califican a los líderes de estos regímenes como “tiranos”, con todo el sentido peyorativo de la palabra. A pesar de esto, no sólo hombres de política se sumergen en el mundo del autoritarismo; las respectivas iglesias de la religión dominante en cierto territorio pueden, si se le es otorgado el poder, gobernar bajo un concepto cerrado, basado sólo en las enseñanzas que sus textos sagrados puedan proveerles.